28.03.2025

如何连接到您的GPU专用服务器

连接到GPU 专用服务器的过程包括多个阶段:从选择合适的套餐到设置和开始工作。以下是成功连接和使用服务器的主要步骤。

选择合适的套餐

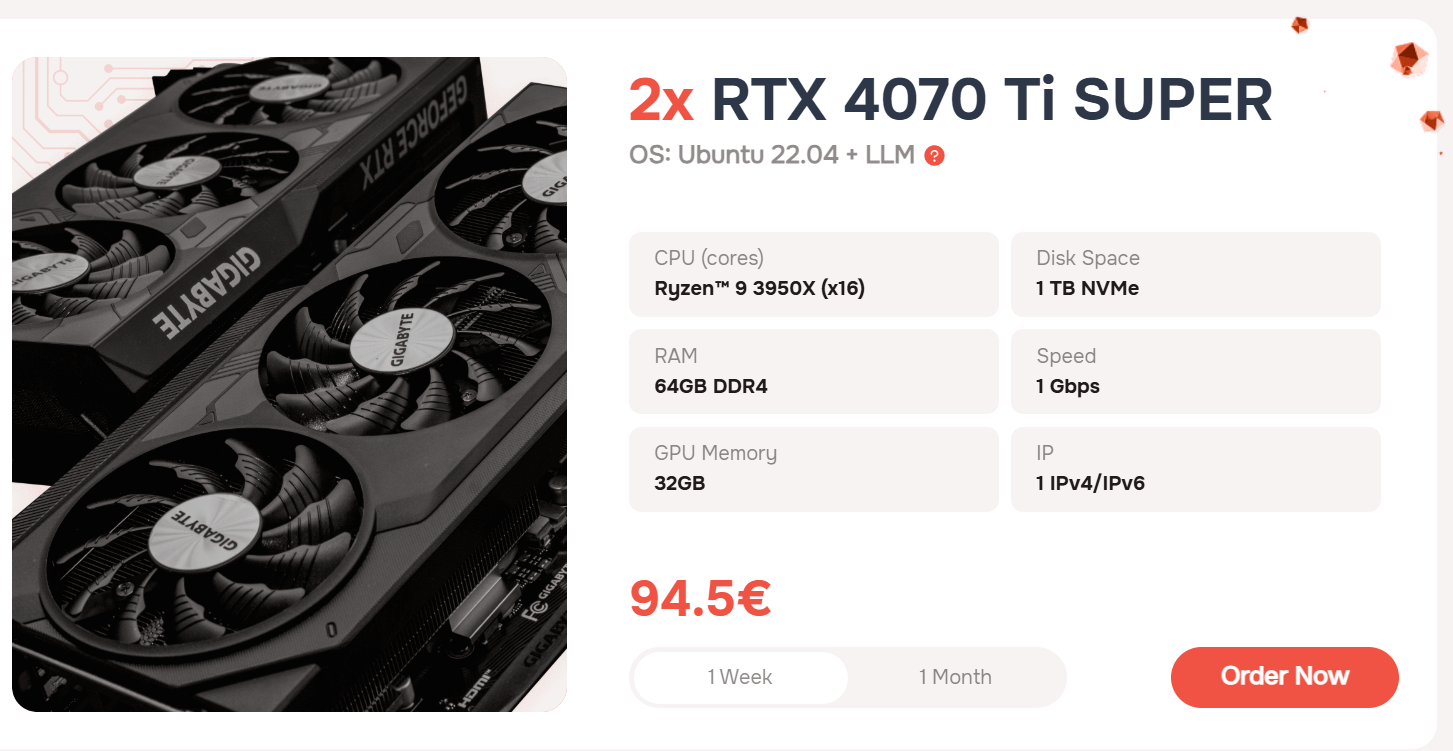

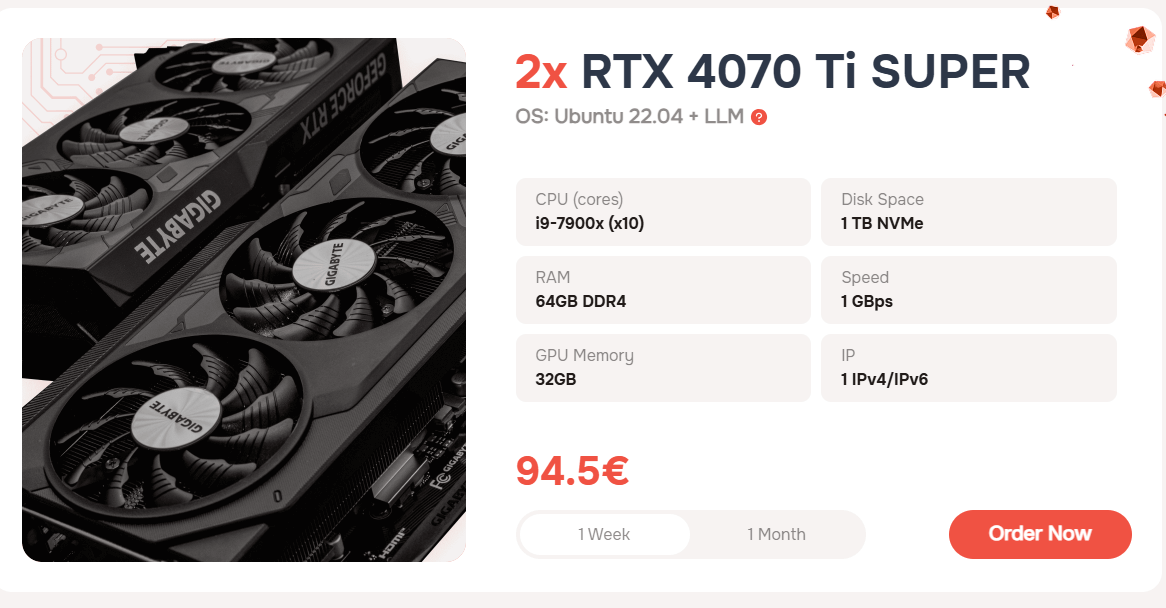

AlexHost 提供两种 GPU 专用服务器套餐:

专用服务器配备了两块强大且现代的2x RTX 4070 Ti SUPER显卡。另一个重要元素是,AlexHost 提供了一整套预装工具和框架,专门设计用于简化大型语言模型(LLMs)的部署和使用,使您能够立即开始使用 AI 解决方案。这将帮助您立即获得一个可部署的 AI 工具的服务器。

- Oobabooga 文本生成 UI

- PyTorch (CUDA 12.4 + cuDNN)

- SD Webui A1111

- Ubuntu 22.04 虚拟机:GNOME 桌面 + RDPXFCE 桌面 + RDPKDE Plasma 桌面 + RDP

- 另外:应要求,我们可以安装任何操作系统

如何连接到您的 GPU 服务器

成功付款后,您将收到服务器的访问权限和凭据到您的电子邮件。我们也准备提供有关如何连接到您的 GPU 专用服务器的说明。说明非常简单,只需按照下面描述的步骤进行操作。

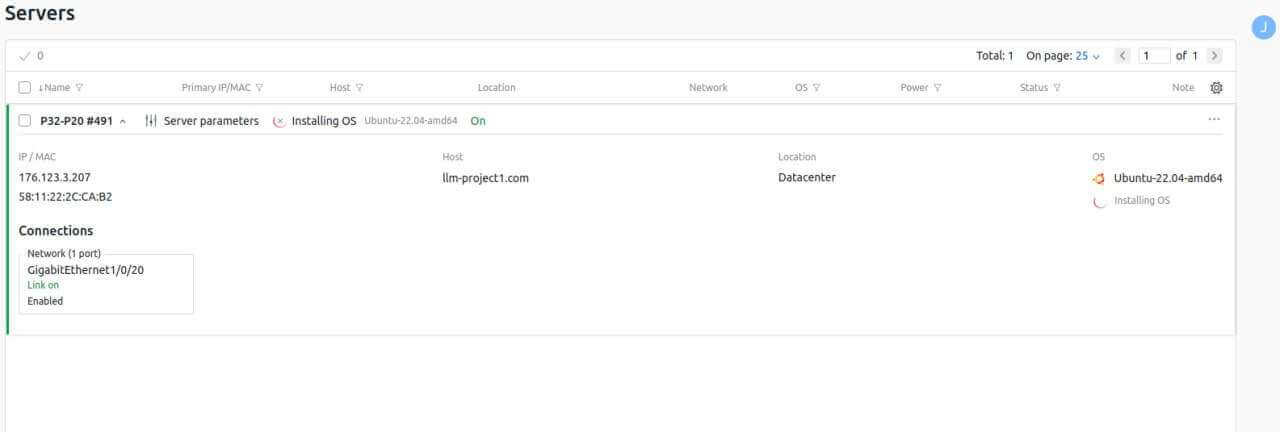

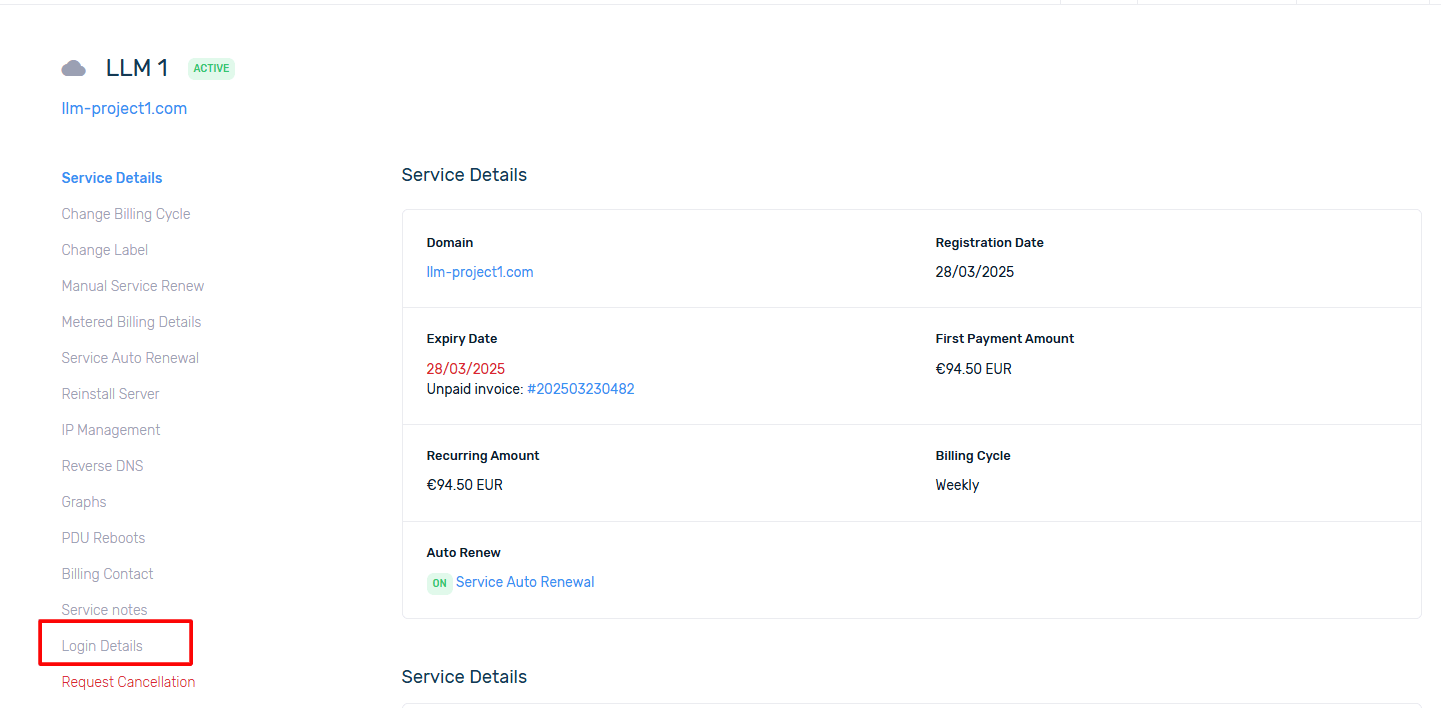

因此,在成功订购 GPU 服务器后,您可以进入您的帐户并从已激活服务的列表中选择它。然后通过单击所选服务打开它。

要查看DCIManager的登录凭据,您需要转到登录详细信息部分

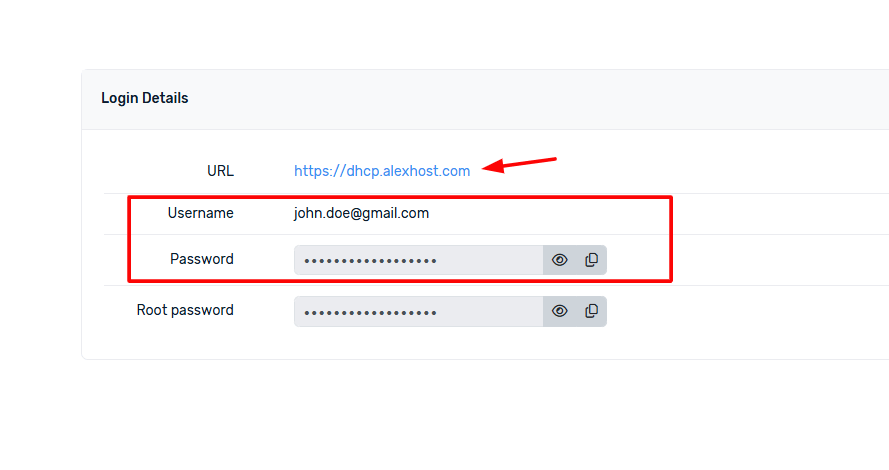

您将能够通过您帐户中提供的链接,并在那里查看用户名和相应的密码。

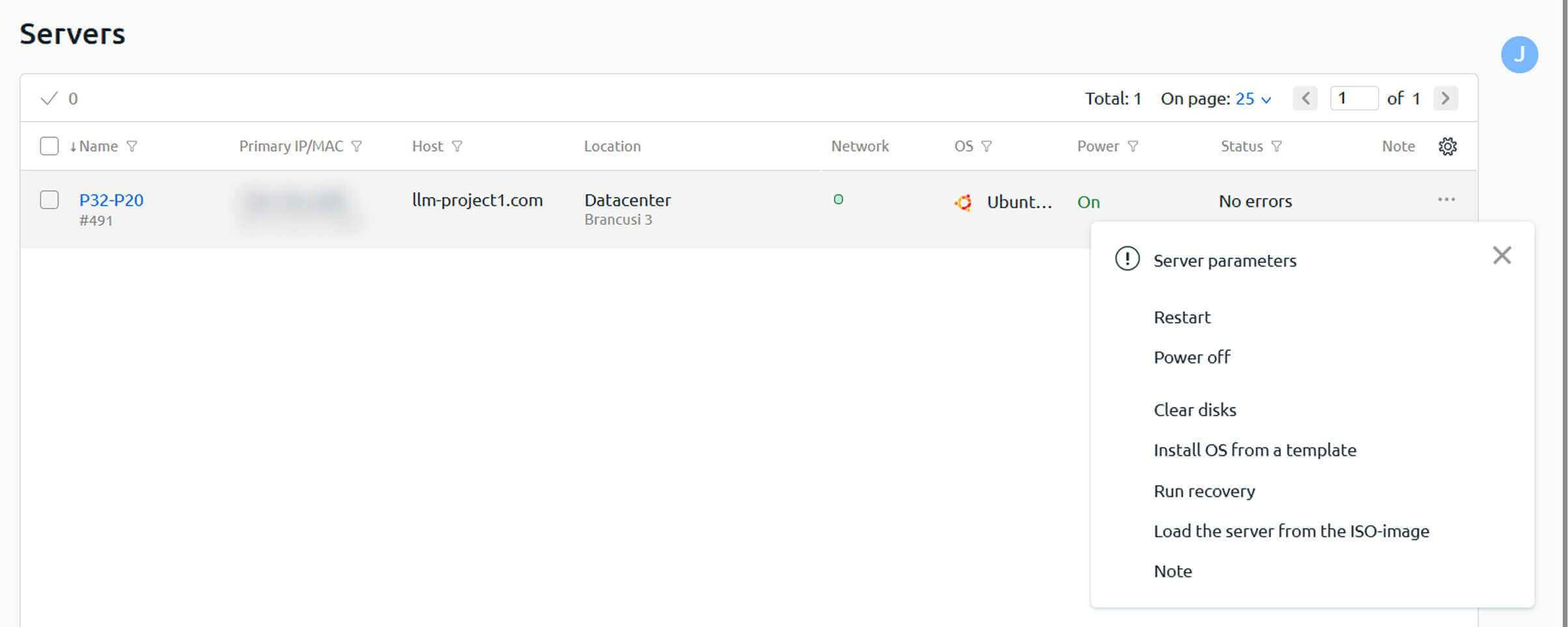

选择三个点后,您应该单击“从模板安装操作系统”以查看可用的操作系统和 LLM 模型

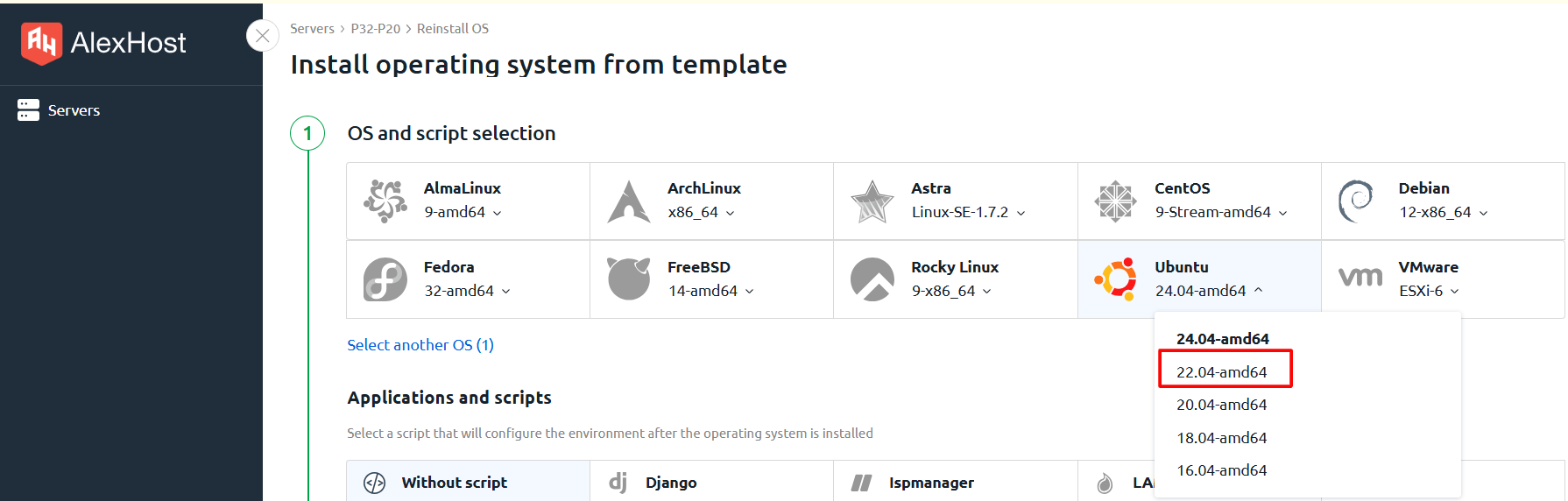

您可以在 GPU 服务器上安装模板列表中提供的任何操作系统。

目前,处理大型语言模型(LLMs)的框架和工具仅支持 Ubuntu 22.04。当选择此操作系统时,相应的 LLM 框架安装脚本将在设置过程中可供选择。

目前,处理大型语言模型(LLMs)的框架和工具仅支持 Ubuntu 22.04。当选择此操作系统时,相应的 LLM 框架安装脚本将在设置过程中可供选择。

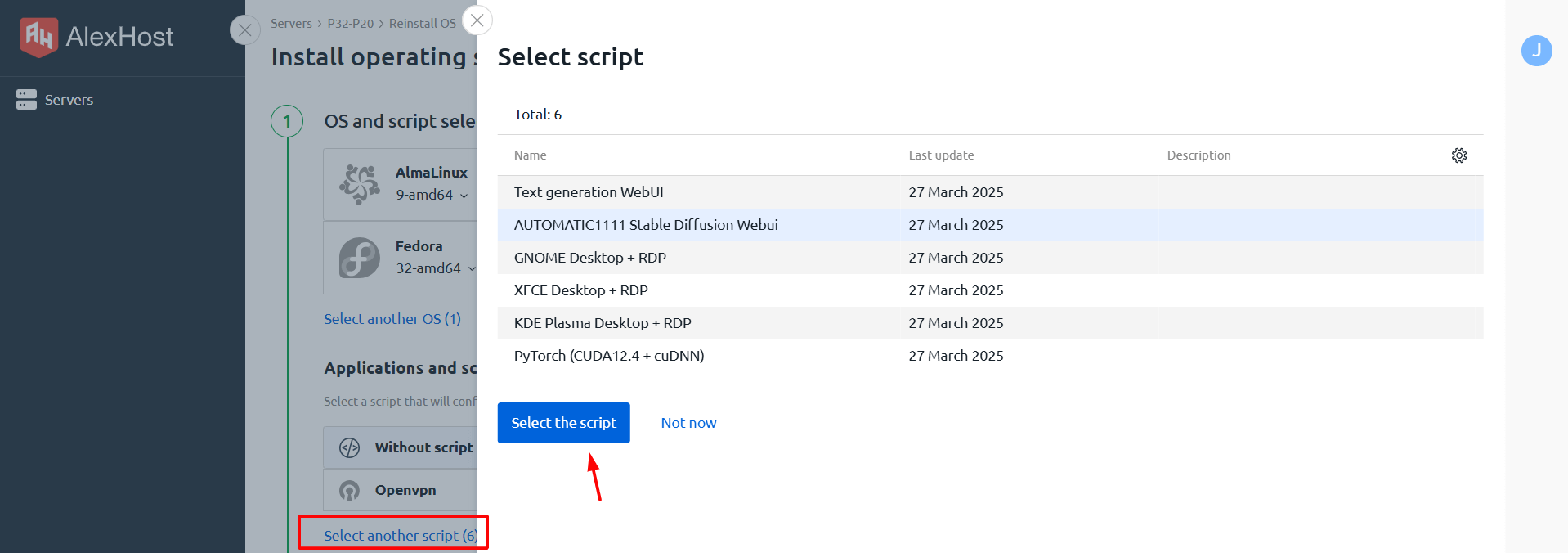

通过选择“选择其他脚本”选项,您将能够安装所有可用的 LLM 模型。让我们快速了解每一个:

- 文本生成 WebUI 是一个用于处理文本生成模型(如 GPT、LLaMA、Mistral 等)的 Web 界面。它允许您加载模型、配置参数并与文本 LLM 进行交互。

- AUTOMATIC1111 稳定扩散 WebUI 是使用稳定扩散模型生成图像的最流行的 Web 界面之一。它提供了一个方便的 GUI,您可以在其中加载模型、配置图像生成参数、使用附加插件和扩展。

- GNOME / XFCE / KDE Plasma 桌面 + RDP 是通过 RDP(远程桌面协议)远程连接到服务器的各种图形环境。它们与 LLM 没有直接关系,但可以用于管理和处理运行 AI 模型的服务器。

- PyTorch (CUDA12.4 + cuDNN) 是一个用于处理神经网络和机器学习的库。它支持 GPU 加速(通过 CUDA),并用于训练和运行 LLM(例如 GPT、LLaMA)和图像生成模型(稳定扩散)。

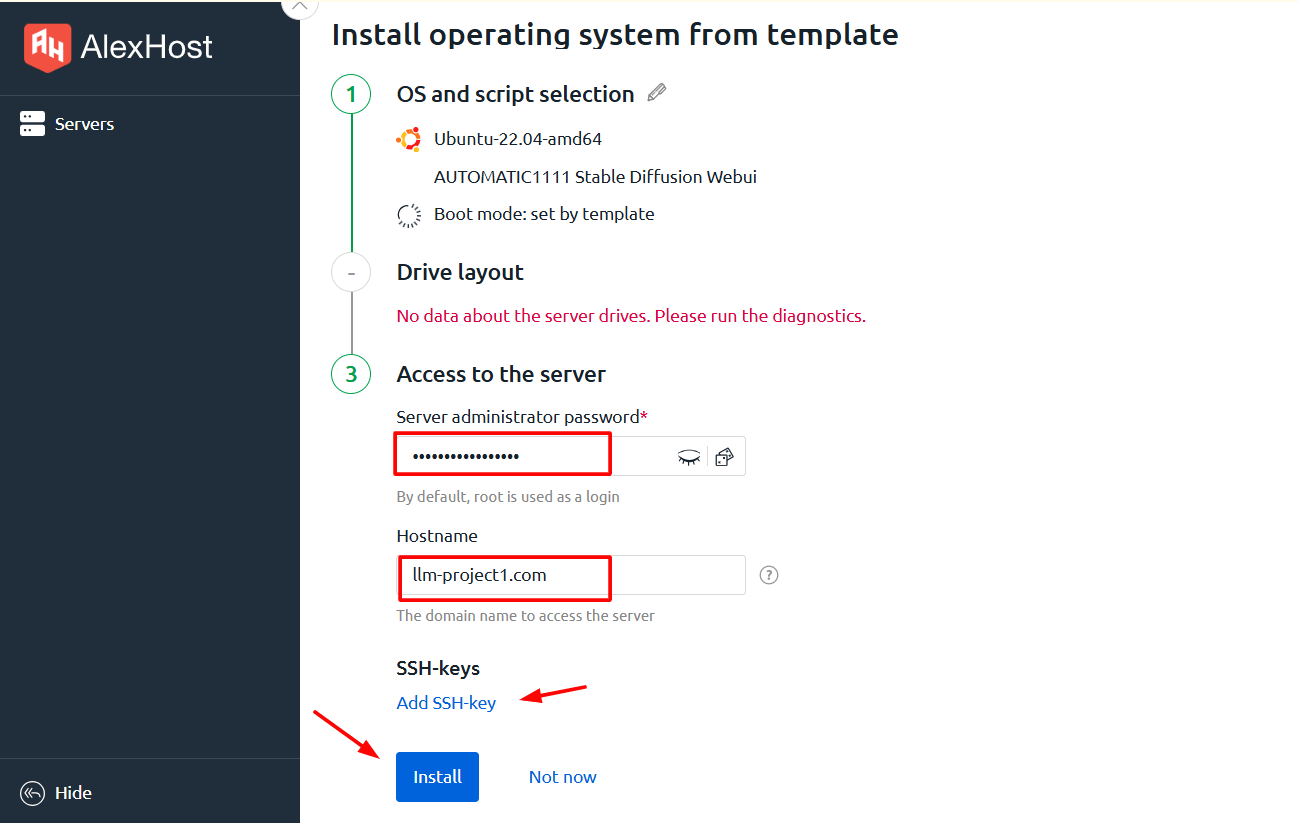

最后一步是选择密码和主机名。在填写这些字段后,您可以继续安装。

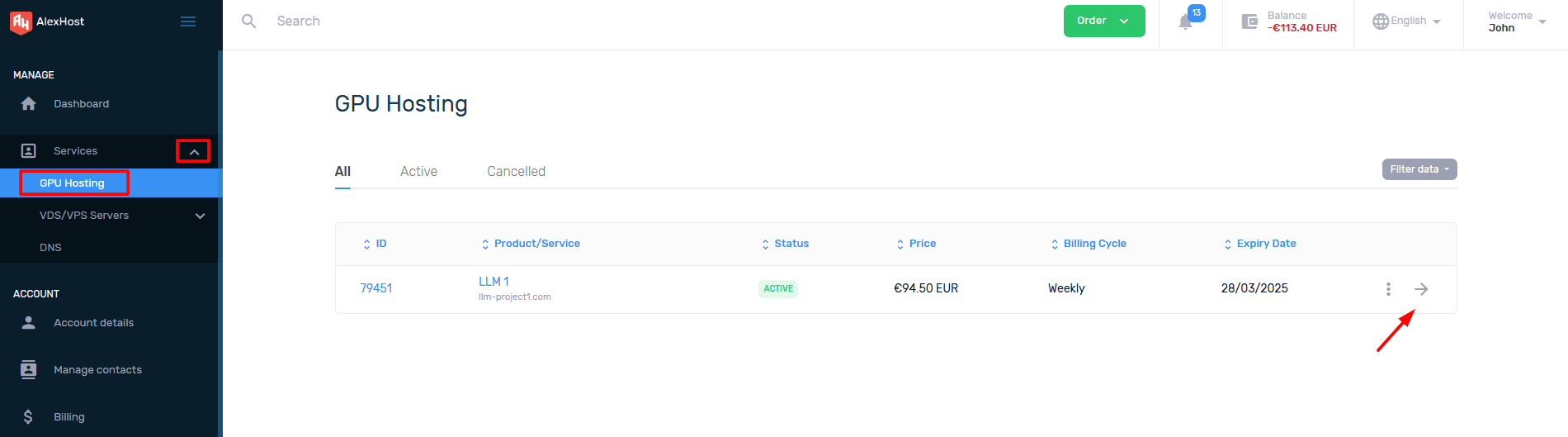

成功的安装过程看起来正是这样。请注意,安装过程可能需要长达 30 分钟。