Kluczowe cechy

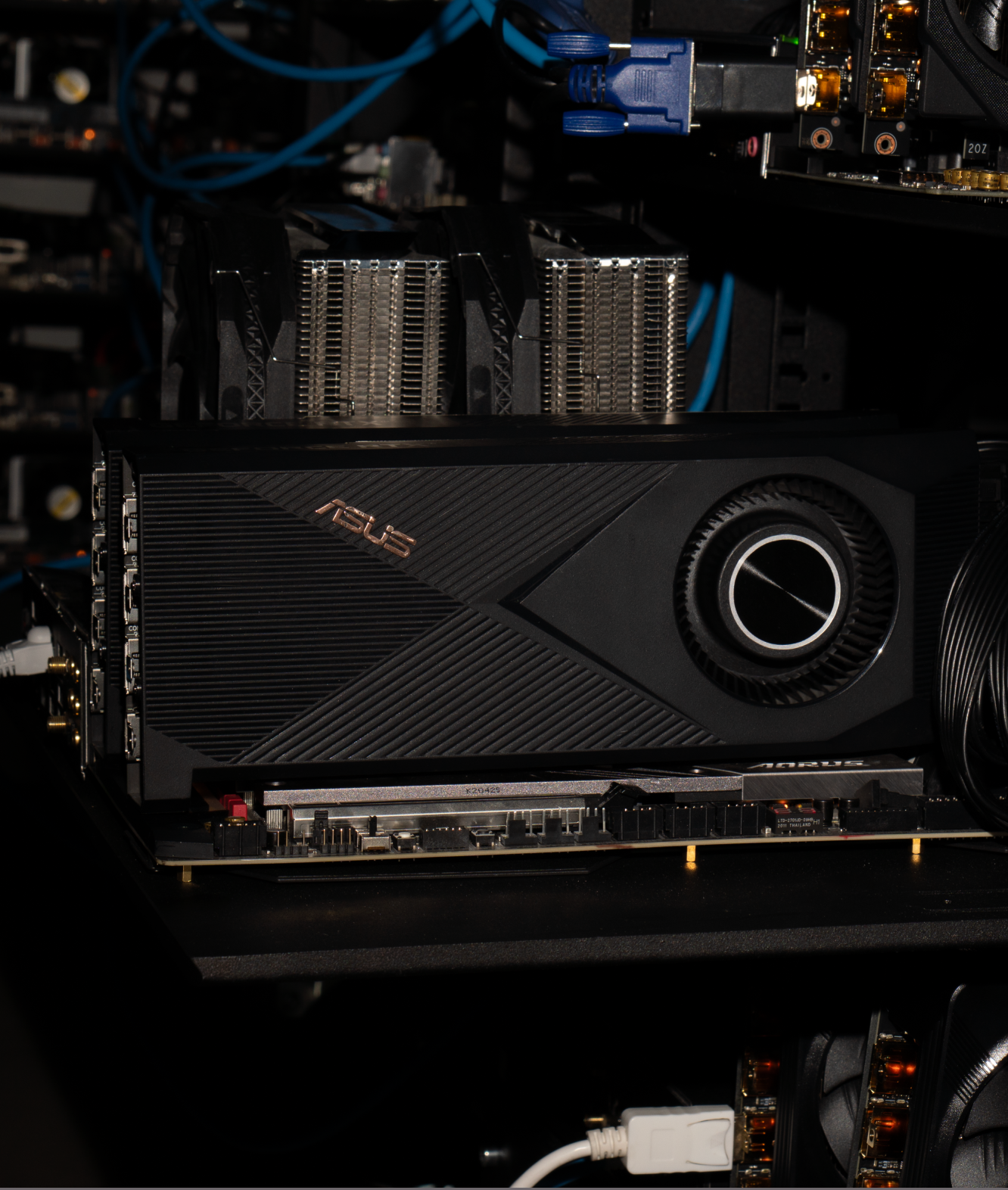

Wysoka wydajność RTX 4070 Ti SUPER & NVIDIA GeForce RTX 5080 Ti

Elastyczne płatności

Wielordzeniowe procesory

Szybsze szkolenie dla dużych modeli językowych (LLM)

2x NVIDIA GeForce RTX 4070 Ti SUPER  System operacyjny: Ubuntu 22.04 + LLM

System operacyjny: Ubuntu 22.04 + LLM

94.5€

2x NVIDIA GeForce RTX 4070 Ti SUPER  System operacyjny: Ubuntu 22.04 + LLM

System operacyjny: Ubuntu 22.04 + LLM

94.5€

2x NVIDIA GeForce RTX 5080 Ti  System operacyjny: Ubuntu 22.04 + LLM

System operacyjny: Ubuntu 22.04 + LLM

134.50€

1x NVIDIA GeForce RTX 4070 TI SUPER  System operacyjny: Ubuntu 22.04 + LLM

System operacyjny: Ubuntu 22.04 + LLM

300.00€

2x ASUS Turbo GeForce RTX 3090  System operacyjny: Ubuntu 22.04 + LLM

System operacyjny: Ubuntu 22.04 + LLM

94.50€

Zaprojektowany dla AI i obciążeń wymagających dużej mocy obliczeniowej

Szkolenie AI

Dzięki tysiącom rdzeni obliczeniowych, układ GPU zasilany przez podwójną kartę graficzną 4070 Ti i GeForce RTX 5080 Ti równolegle wykonuje operacje i obliczenia macierzowe. Znacznie przyspiesza to zadania szkoleniowe AI w porównaniu z tradycyjnymi procesorami centralnymi.

Uczenie głębokie

Układy GPU skutecznie radzą sobie z intensywnymi wymaganiami obliczeniowymi głębokich sieci neuronowych i rekurencyjnych sieci neuronowych, które są niezbędne do opracowywania zaawansowanych modeli głębokiego uczenia, w tym generatywnej sztucznej inteligencji.

Obliczenia o wysokiej wydajności

Doskonała wydajność GPU, w szczególności dzięki dwóm kartom 4070 Ti z 16 GB pamięci GDDR6X i 7680 rdzeniami CUDA oraz GeForce RTX 5080 Ticores, jest idealna do intensywnych obliczeń, w tym dynamicznych algorytmów programowania, renderowania wideo i symulacji naukowych.

Analiza danych

Układy GPU oferują wysoką przepustowość pamięci i wydajne możliwości transferu danych, usprawniając przetwarzanie i manipulowanie dużymi zbiorami danych w celu szybszej analizy. Szybkość pamięci 4070 Ti i GeForce RTX 5080 Ti na poziomie 21 Gb/s oraz zaawansowana architektura redukują wąskie gardła danych, przyspieszając wykonywanie zadań.

Wybierz swoją konfigurację: AI, UI i zdalny dostęp

-

Oobabooga Text Gen UI

-

PyTorch (CUDA 12.4 + cuDNN)

-

SD Webui A1111

-

Maszyna wirtualna Ubuntu 22.04

Również: Na życzenie możemy zainstalować dowolny system operacyjny

Również: Na życzenie możemy zainstalować dowolny system operacyjny

Specyfikacja

Względna wydajność

Przepustowość pamięci

Hosting serwerów LLM: Obciążenia związane ze sztuczną inteligencją dzięki AlexHost

W miarę jak duże modele językowe (LLM) stają się coraz ważniejsze dla rozwoju sztucznej inteligencji, zapotrzebowanie na hosting serwerów LLM stale rośnie. Niezależnie od tego, czy wdrażasz modele przetwarzania języka naturalnego, trenujesz złożone systemy uczenia maszynowego, czy też przeprowadzasz wnioskowanie na dużą skalę, wybór niezawodnego rozwiązania hostingowego opartego na GPU ma kluczowe znaczenie. AlexHost, zaufana marka w dziedzinie wysokowydajnej infrastruktury, oferuje najnowocześniejsze serwery zoptymalizowane pod kątem LLM - łączące wydajność, przystępną cenę i prywatność.

Hosting LLM z AlexHost: Zaprojektowany dla szybkości, Zbudowany dla skali

Jeśli chodzi o hosting LLM, nie wszystkie serwery są sobie równe. Potrzebujesz dostawcy hostingu, który zapewnia stabilną infrastrukturę, połączenia o wysokiej przepustowości i moc GPU dostosowaną do obciążeń AI. AlexHost oferuje wyspecjalizowane rozwiązania stworzone specjalnie dla naukowców zajmujących się danymi, startupów AI i klientów korporacyjnych pracujących z LLM.

Z naciskiem na serwery bare metal GPU

AlexHost umożliwia firmom przyspieszenie szkolenia modeli, zmniejszenie opóźnień wnioskowania i utrzymanie kosztów operacyjnych pod kontrolą. Każde wdrożenie LLM hostowane przez AlexHost korzysta z pełnego dostępu root, ochrony DDoS i sprzętu klasy korporacyjnej - a wszystko to w zgodnym z RODO, zagranicznym centrum danych zlokalizowanym w Mołdawii.

Dlaczego warto wybrać AlexHost dla serwera hostującego GPU z możliwościami LLM?

Jeśli pracujesz nad modelami opartymi na transformatorach, generatywnymi systemami sztucznej inteligencji lub silnikami chatbotów w czasie rzeczywistym, potrzebujesz solidnego serwera hostingowego GPU z funkcjami LLM. AlexHost oferuje te funkcje. Zapewniają one, że obciążenia AI pozostają szybkie, bezpieczne i zawsze dostępne - niezależnie od tego, czy jesteś w fazie badań, rozwoju czy produkcji.

Hosting z GPU dla LLM Przewaga AlexHost

Wybór hostingu z GPU dla LLM nie sprowadza się tylko do specyfikacji - chodzi również o usługi, czas pracy i kontrolę. AlexHost zapewnia hosting privacy-focused wolny od ograniczeń DMCA, dając ci pełną swobodę wprowadzania innowacji. Niezależnie od tego, czy szkolisz LLM o otwartym kodzie źródłowym, czy hostujesz prywatnego asystenta AI, możesz to robić z pełnym zaufaniem i kontrolą.

Szukasz taniego serwera GPU do projektów LLM?

Jedną z wyróżniających się ofert AlexHost jest tani serwer GPU do wdrażania LLM

Idealne rozwiązanie dla deweloperów, badaczy i entuzjastów sztucznej inteligencji, którzy potrzebują mocy GPU bez rozbijania banku. Plany te zostały zaprojektowane z myślą o przystępnej cenie i wydajności, dzięki czemu idealnie nadają się do trenowania lekkich modeli, uruchamiania precyzyjnie dostrojonych LLM lub obsługi punktów końcowych wnioskowania w czasie rzeczywistym.

Wszystkie plany hostingowe z ignorowaniem DMCA:

- Dedykowane zasoby GPUW pełni izolowane środowisko

- Wysokie przydziały pamięci RAMOdpowiedni do zadań uczenia głębokiego

- Pamięć masowa NVMe SSDbłyskawiczny dostęp do danych i zapisywanie punktów kontrolnych

- Pełny dostęp rootaDostosowanie na poziomie systemu operacyjnego Ochrona przed atakami DDoS i hosting danych privacy-focused w celu zwiększenia prywatności

- Ochrona przed atakami DDoSHosting danych privacy-focused zapewniający większą prywatność

W przeciwieństwie do wielu dostawców usług w chmurze, którzy oferują współdzielony lub ograniczony dostęp do GPU po wyższych stawkach

AlexHost zapewnia opłacalną infrastrukturę dostosowaną do przepływów pracy AI. Niezależnie od tego, czy pracujesz z PyTorch, TensorFlow, czy korzystasz z popularnych frameworków, takich jak Hugging Face Transformers, te środowiska serwerowe są zoptymalizowane pod kątem wdrażania LLM od pierwszego dnia.

Co więcej

AlexHost oferuje elastyczne cykle rozliczeniowe, pozwalając płacić miesięcznie lub godzinowo, dzięki czemu wydajesz tylko wtedy, gdy faktycznie potrzebujesz czasu obliczeniowego. Jest to szczególnie przydatne dla startupów pracujących z ograniczonymi budżetami lub dla programistów, którzy muszą uruchamiać tymczasowe środowiska szkoleniowe na żądanie.

Niezależnie od tego, czy trenujesz modele, hostujesz punkty końcowe wnioskowania, czy tworzysz aplikacje oparte na sztucznej inteligencji, AlexHost pozwala Ci robić więcej – szybciej, bezpieczniej i taniejPotrzebujesz niestandardowej konfiguracji? Nasz zespół wsparcia jest dostępny 24 godziny na dobę, 7 dni w tygodniu, aby pomóc Ci skonfigurować idealne środowisko dla Twojego projektu LLM, dostosowane do Twoich dokładnych wymagań dotyczących zasobów i budżetu.