Beschleunigen Sie die KI-Entwicklung mit dem hochmodernen GPU-Hosting von AlexHost

In der sich schnell entwickelnden Landschaft der künstlichen Intelligenz ist die Rechenleistung von größter Bedeutung. Ganz gleich, ob Sie große Sprachmodelle trainieren, Computer-Vision-Anwendungen einsetzen oder generative KI-Systeme entwickeln, die GPU-Hosting-Lösungen von AlexHost bieten die robuste Infrastruktur, die Sie benötigen, um diese Anforderungen zu erfüllen.

Entwickelt für anspruchsvolle KI-Workloads

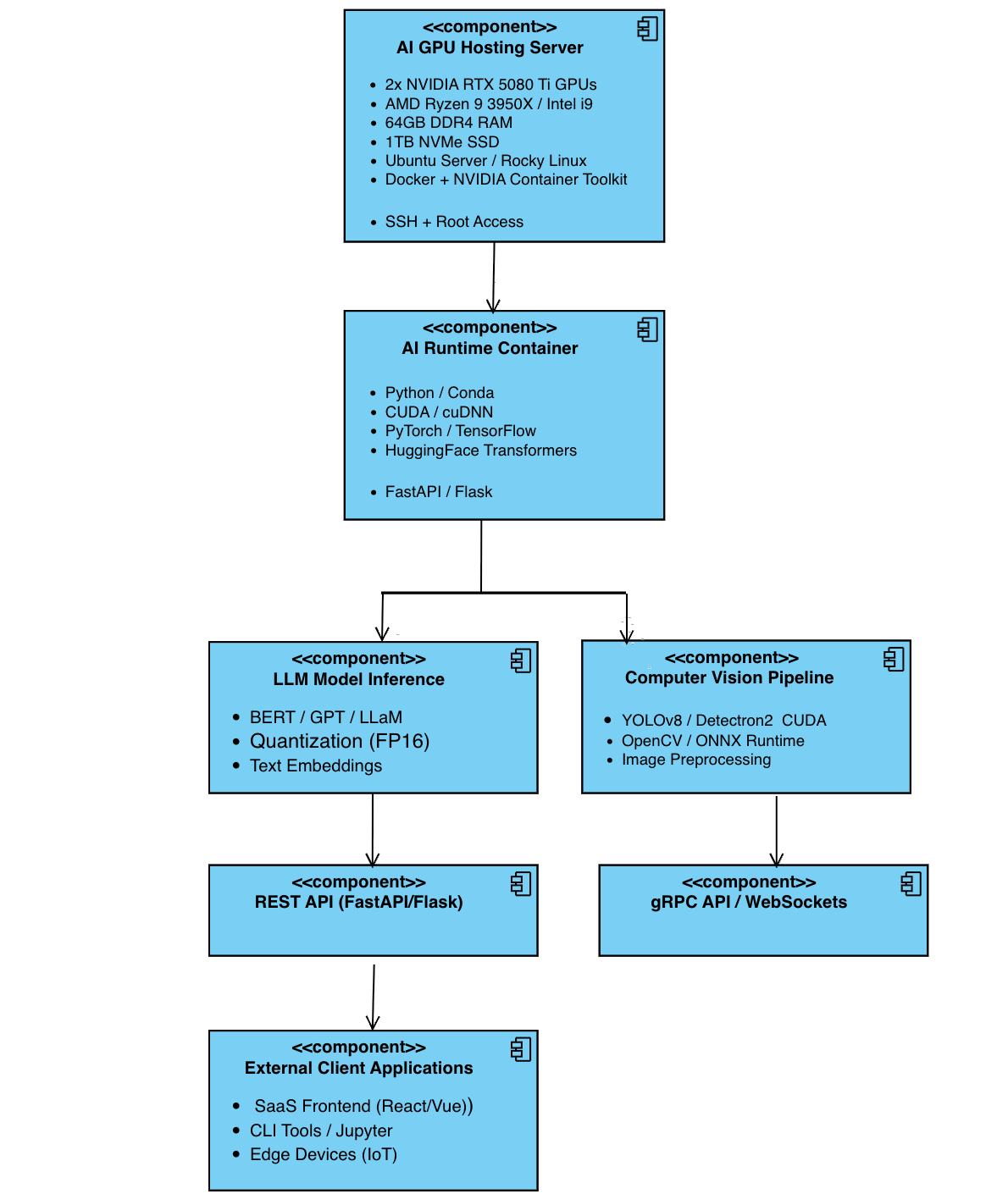

Die GPU-Hosting-Infrastruktur von AlexHost wurde sorgfältig für die Unterstützung intensiver KI-Workloads entwickelt, wobei der Schwerpunkt auf Deep Learning, Modelltraining und groß angelegten Inferenzen liegt. Die Plattform verfügt über Architekturen mit hohem Durchsatz und niedriger Latenz, die von 2 NVIDIA GeForce RTX 5080 Ti-GPUs angetrieben werden, die für ihre CUDA-Kerndichte, Speicherbandbreite und parallelen Berechnungsfähigkeiten bekannt sind.

Diese Systeme sind für fortschrittliche KI-Anwendungen optimiert, darunter:

- Überwachtes und unüberwachtes Deep-Learning-Training, das anhaltende FP16/FP32-Berechnungen und eine hohe VRAM-Nutzung erfordert.

- Feinabstimmung transformatorbasierter Architekturen wie LLMs (z. B. BERT, GPT), Diffusionsmodelle und GANs, die schnelle Verbindungen und einen hohen Speicherdurchsatz erfordern.

- Aufgabender natürlichen Sprachverarbeitung (NLP) wie Sequenzmodellierung, Textklassifizierung und kontextuelle Einbettung, die eine hohe Kernparallelität und GPU-Beschleunigung erfordern.

- Computer-Vision-Anwendungen, einschließlich Objekterkennung in Echtzeit, Segmentierung, OCR und Multibild-Überwachungsanalysen.

- Edge AI- und Federated Learning-Szenarien, bei denen GPU-Verarbeitung mit niedriger Latenz für verteiltes, datenschutzgerechtes Lernen und geräteinterne Inferenzen entscheidend ist.

Die Infrastruktur von AlexHost unterstützt Passthrough-PCIe-Zugriff und echte Bare-Metal-Implementierungen, wodurch der Virtualisierungs-Overhead entfällt und die Benutzer direkten Zugriff auf den gesamten GPU-Ressourcenstapel erhalten. Dies ist entscheidend für Szenarien, die eine präzise Hardwareabstimmung, deterministische Leistung und Kompatibilität mit Low-Level-CUDA- oder ML-Framework-Optimierungen (z. B. NCCL, cuDNN, TensorRT) erfordern.

Konfigurationen, die mit Ihnen skalieren

AlexHost bietet ein modulares und leistungsangepasstes GPU-Server-Portfolio, das mit den wachsenden Anforderungen der KI-Entwicklung skaliert werden kann. Benutzer können aus verschiedenen Hardware-Konfigurationen wählen, darunter:

- 2x NVIDIA GeForce RTX 5080 Ti GPUs: Jeweils 16 GB GDDR6X-Speicher, insgesamt 32 GB VRAM, die außergewöhnliche Leistung für KI-Workloads bieten.

- Intel Core i9-7900X: 10 Kerne, geeignet für hochfrequente Aufgaben.

- AMD Ryzen™ 9 3950X: 16 Kerne, bietet robuste Multithreading-Leistung.

- Arbeitsspeicher: 64 GB DDR4-RAM, der ausreichend Kapazität für komplexe Multi-Thread-KI-Aufgaben bietet.

- Speicher: 1 TB NVMe-SSD, die Hochgeschwindigkeitsdatenzugriff für große Datensätze und Modellprüfpunkte bietet.

- Netzwerk: 1 Gbit/s Bandbreite, die eine schnelle Datenübertragung für verteiltes Training und Echtzeit-Inferenz ermöglicht.

- IP-Konfiguration: 1 IPv4/IPv6-Adresse enthalten.

Diese Konfigurationen sind ideal für Startups, die KI-gestützte SaaS-Produkte entwickeln, Forschungseinrichtungen, die komplexe Simulationen durchführen, oder Unternehmen, die umfangreiche KI-Modelle einsetzen.

Datenschutzorientiertes Hosting für KI-Innovationen – Erweitert

Neben der reinen Leistung und Skalierbarkeit legt AlexHost besonderen Wert auf Datenschutz, Isolierung der Infrastruktur und souveräne Rechenkontrolle – und ist damit eine ideale Umgebung für die datenschutzfreundliche Entwicklung und Bereitstellung von KI.

Vollständige Datenkontrolle und Isolierung der Compliance

AlexHost liefert Bare-Metal-GPU-Server mit exklusiver Hardware-Zuweisung, die sicherstellt, dass:

- Es gibt keine Virtualisierungsschichten oder gemeinsam genutzte Hypervisoren, die das Risiko von Leckagen über Seitenkanäle verursachen können.

- Alle Speicher-, Grafikprozessor- und Festplattenressourcen sind pro Kunde isoliert, wodurch Noisy-Neighbor-Effekte oder unbefugter mandantenübergreifender Zugriff ausgeschlossen werden.

- Keine gemeinsame Nutzung – Ihre Modelle, Datensätze und Laufzeitumgebungen bleiben vollständig unter Ihrer Kontrolle.

Diese Infrastruktur ist besonders geeignet für:

- Federated Learning und vertrauliches KI-Training, bei dem die Datensätze lokal auf dem Server bleiben müssen.

- Feinabstimmung von Modellen unter Wahrung der Privatsphäre mit sensiblen medizinischen, rechtlichen oder finanziellen Daten.

- Sicheres Cloud-Computing im On-Premise-Stil für Unternehmenskunden, die regulatorische Unabhängigkeit benötigen.

Bare-Metal-Architektur für sensible KI-Entwicklung

Unser Bare-Metal-GPU-Hosting gewährleistet:

- Vollständiger Root-Zugriff auf das Host-System mit der Möglichkeit, gehärtete Linux-Kernel, Audit-Logging-Tools, Festplattenverschlüsselung (LUKS) oder sichere Enklaven zu installieren.

- Native Unterstützung für Low-Level-Optimierungsbibliotheken (cuDNN, NCCL, TensorRT) mit deterministischer Leistung und maximalem GPU-Durchsatz.

- Möglichkeit der Bereitstellung von Air-Gapped-Trainingsknoten, die über benutzerdefinierte Firewall/NAT-Konfigurationen physisch vom öffentlichen Internet isoliert sind.

AlexHost-Kunden können auch ihren eigenen Hypervisor-Stack (z. B. Proxmox, KVM, Xen) einbringen, um private Clouds auf GPU-fähigen Knoten aufzubauen – so haben DevOps- und MLOps-Teams die volle Kontrolle über Infrastruktur und Workload-Planung.