Ключови характеристики

Висока производителност RTX 4070 Ti SUPER & NVIDIA GeForce RTX 5080 Ti

Гъвкави плащания

Многоядрени процесори

По-бързо обучение за големи езикови модели (LLM)

2x NVIDIA GeForce RTX 4070 Ti SUPER  ОС: Ubuntu 22.04 + LLM

ОС: Ubuntu 22.04 + LLM

94.5€

2x NVIDIA GeForce RTX 4070 Ti SUPER  ОС: Ubuntu 22.04 + LLM

ОС: Ubuntu 22.04 + LLM

94.5€

2x NVIDIA GeForce RTX 5080 Ti  ОС: Ubuntu 22.04 + LLM

ОС: Ubuntu 22.04 + LLM

134.50€

1x NVIDIA GeForce RTX 4070 TI SUPER  ОС: Ubuntu 22.04 + LLM

ОС: Ubuntu 22.04 + LLM

300.00€

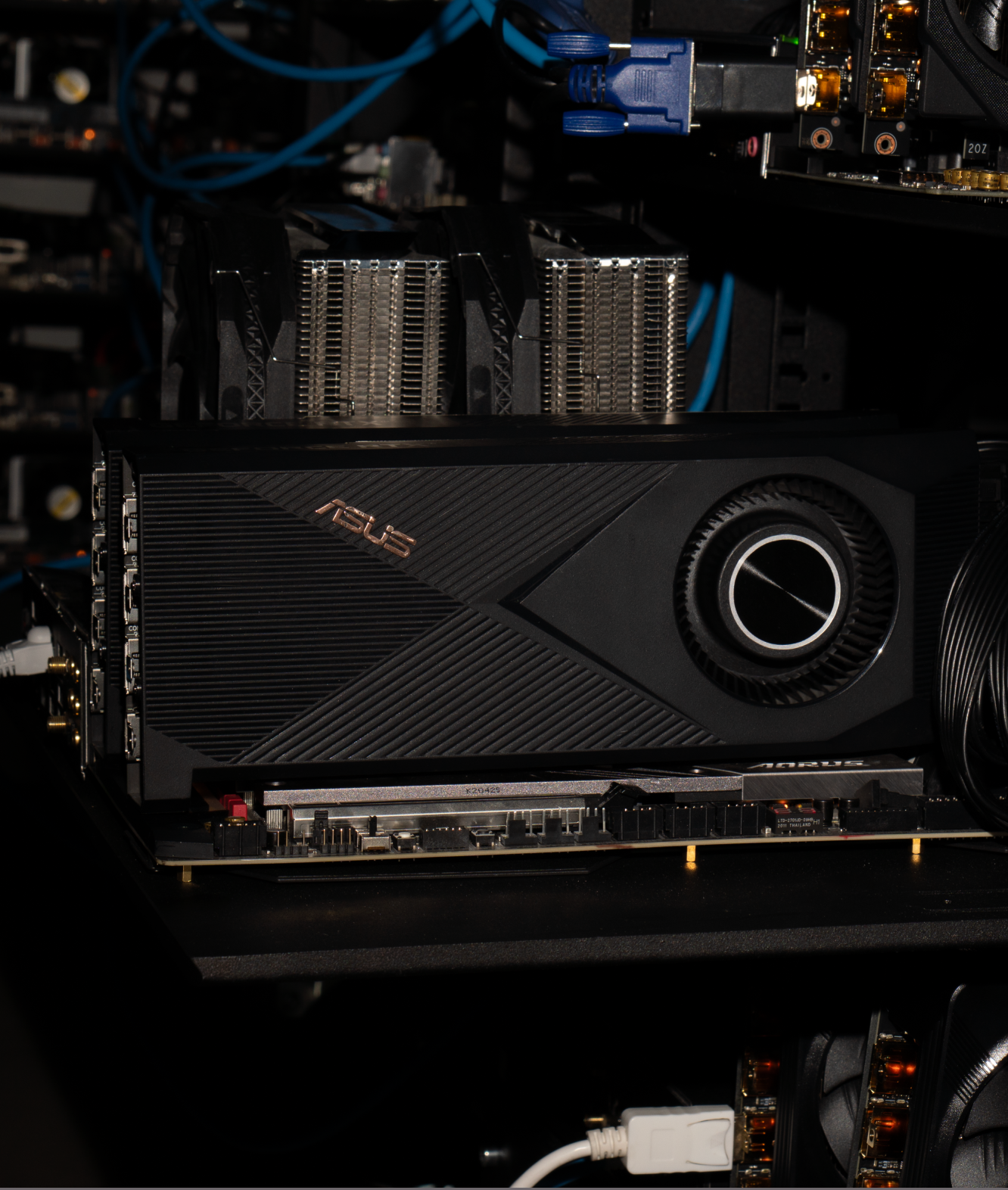

2x ASUS Turbo GeForce RTX 3090  ОС: Ubuntu 22.04 + LLM

ОС: Ubuntu 22.04 + LLM

94.50€

Проектиран за AI и интензивни изчислителни натоварвания

AI обучение

С хилядите си процесорни ядра графичният процесор, захранван от две карти 4070 Ti, може да изпълнява паралелно множество матрични операции и изчисления. Това значително ускорява задачите за обучение на ИИ в сравнение с традиционните процесори.

Дълбоко обучение

Графичните процесори управляват ефективно интензивните изчислителни изисквания на дълбоките невронни мрежи и повтарящите се невронни мрежи, които са от съществено значение за разработването на сложни модели за дълбоко обучение, включително генериращ AI.

Високопроизводителни изчисления

Превъзходната производителност на графичните процесори, особено с 16GB GDDR6X памет и 7680 CUDA ядра на двойния 4070 Ti и GeForce RTX 5080 Ticores, е идеална за интензивни изчислителни натоварвания, включително алгоритми за динамично програмиране, рендиране на видео и научни симулации.

Анализ на данни

Графичните процесори предлагат висока пропускателна способност на паметта и ефикасни възможности за прехвърляне на данни, което подобрява обработката и манипулирането на големи масиви от данни за по-бърз анализ. Скоростта на паметта и усъвършенстваната архитектура на 4070 Ti и GeForce RTX 5080 Ti от 21 Gbps намаляват пречките пред данните, като ускоряват работните натоварвания.

Изберете вашата настройка: AI, UI и отдалечен достъп

-

Oobabooga Text Gen UI

-

PyTorch (CUDA 12.4 + cuDNN)

-

SD Webui A1111

-

Ubuntu 22.04 VM

Също така: При желание можем да инсталираме всяка ОС

Също така: При желание можем да инсталираме всяка ОС

Спецификации

Относителна производителност

Пропускателна способност на паметта

хостинг на сървър LLM: Захранвайте работните си натоварвания с изкуствен интелект с AlexHost

Тъй като големите езикови модели (LLM) стават все по-важни за разработването на изкуствен интелект, търсенето на сървърен хостинг за LLM продължава да расте. Независимо дали разгръщате модели за обработка на естествен език, обучавате сложни системи за машинно обучение или провеждате мащабни изводи, изборът на надеждно хостинг решение, захранвано от графичен процесор, е от жизненоважно значение. AlexHost, доверено име в областта на високопроизводителната инфраструктура, предлага най-съвременни сървъри, оптимизирани за LLM - съчетаващи производителност, достъпност и поверителност.

LLM хостинг с AlexHost: Проектиран за Скорост, създаден за Мащаб

Когато става въпрос за хостинг на LLM, не всички сървъри са еднакви. Нуждаете се от доставчик на хостинг, който осигурява стабилна инфраструктура, високоскоростни връзки и GPU мощност, съобразена с работните натоварвания с изкуствен интелект. AlexHost предлага специализирани решения, създадени специално за учени в областта на данните, стартъпи в областта на ИИ и корпоративни клиенти, работещи с LLM.

С фокус върху голи метални GPU сървъри

AlexHost дава възможност на компаниите да ускорят обучението на модели, да намалят латентността на изводите и да контролират оперативните разходи. Всяко внедряване на LLM, хоствано при AlexHost, се ползва с пълен root достъп, DDoS защита и хардуер от корпоративен клас - всичко това от офшорен център за данни, отговарящ на изискванията на GDPR и разположен в Молдова.

Защо да изберете AlexHost за сървър за хостинг на GPU с LLM възможности?

Ако работите върху модели, базирани на трансформатори, генеративни системи за изкуствен интелект или двигатели за чатботове в реално време, ще ви е необходим стабилен GPU хостинг сървър с LLM възможности. AlexHost предлага тези функции. Те гарантират, че вашите работни натоварвания, свързани с ИИ, ще останат бързи, сигурни и винаги налични - независимо дали сте във фаза на изследване, разработка или производство.

Хостинг с GPU за LLM Предимството на AlexHost

Изборът на хостинг с графичен процесор за LLM не се свежда само до спецификациите, а и до обслужването, времето за работа и контрола. AlexHost предоставя офшорен хостинг, свободен от ограниченията на DMCA, което ви дава пълна свобода да въвеждате иновации. Независимо дали обучавате LLM с отворен код или хоствате частен асистент с изкуствен интелект, можете да го правите с пълна увереност и контрол.

Търсите евтин GPU сървър за LLM проекти?

Едно от отличителните предложения на AlexHost е евтиният GPU сървър за внедряване на LLM

Перфектно решение за разработчици, изследователи и любители на изкуствения интелект, които се нуждаят от GPU мощност, без да се налага да харчат пари. Тези планове са разработени с оглед на достъпността и производителността, което ги прави идеални за обучение на леки модели, изпълнение на фино настроени LLM или обслужване на крайни точки за изводи в реално време.

Всички хостинг планове с игнориране на DMCA:

- Специализирани ресурси на GPUНапълно изолирана среда

- Високо разпределение на RAMПодходящ за задачи за дълбоко обучение

- Съхранение на NVMe SSDза светкавичен достъп до данни и запазване на контролни точки

- Пълен root достъпИ персонализация на ниво операционна система Защита от DDoS и офшорен хостинг на данни за по-голяма поверителност

- Защита от DDoSИ офшорен хостинг на данни за по-голяма поверителност

За разлика от много доставчици на облачни услуги, които предлагат споделен или ограничен достъп до GPU на високи цени.

AlexHost осигурява рентабилна инфраструктура, съобразена с работните процеси на изкуствения интелект. Независимо дали разработвате с PyTorch, TensorFlow или използвате популярни рамки като Hugging Face Transformers, тези сървърни среди са оптимизирани за внедряване на LLM от първия ден.

Нещо повече

AlexHost предлага гъвкави цикли на таксуване, които ви позволяват да плащате месечно или почасово, така че да харчите само когато действително се нуждаете от изчислително време. Това е особено полезно за стартиращи компании, работещи с ограничени бюджети, или за разработчици, които трябва да създават временни среди за обучение при поискване.

Независимо дали обучавате модели, хоствате крайни точки за изводи или изграждате приложения с изкуствен интелект, AlexHost ви дава възможност да правите повече – по-бързо, по-безопасно и по-достъпноИмате нужда от персонализирана настройка? Нашият екип за поддръжка е на разположение 24 часа в денонощието, 7 дни в седмицата, за да ви помогне да конфигурирате перфектната среда за вашия LLM проект, съобразена с точните ви изисквания за ресурси и бюджет.