Caractéristiques principales

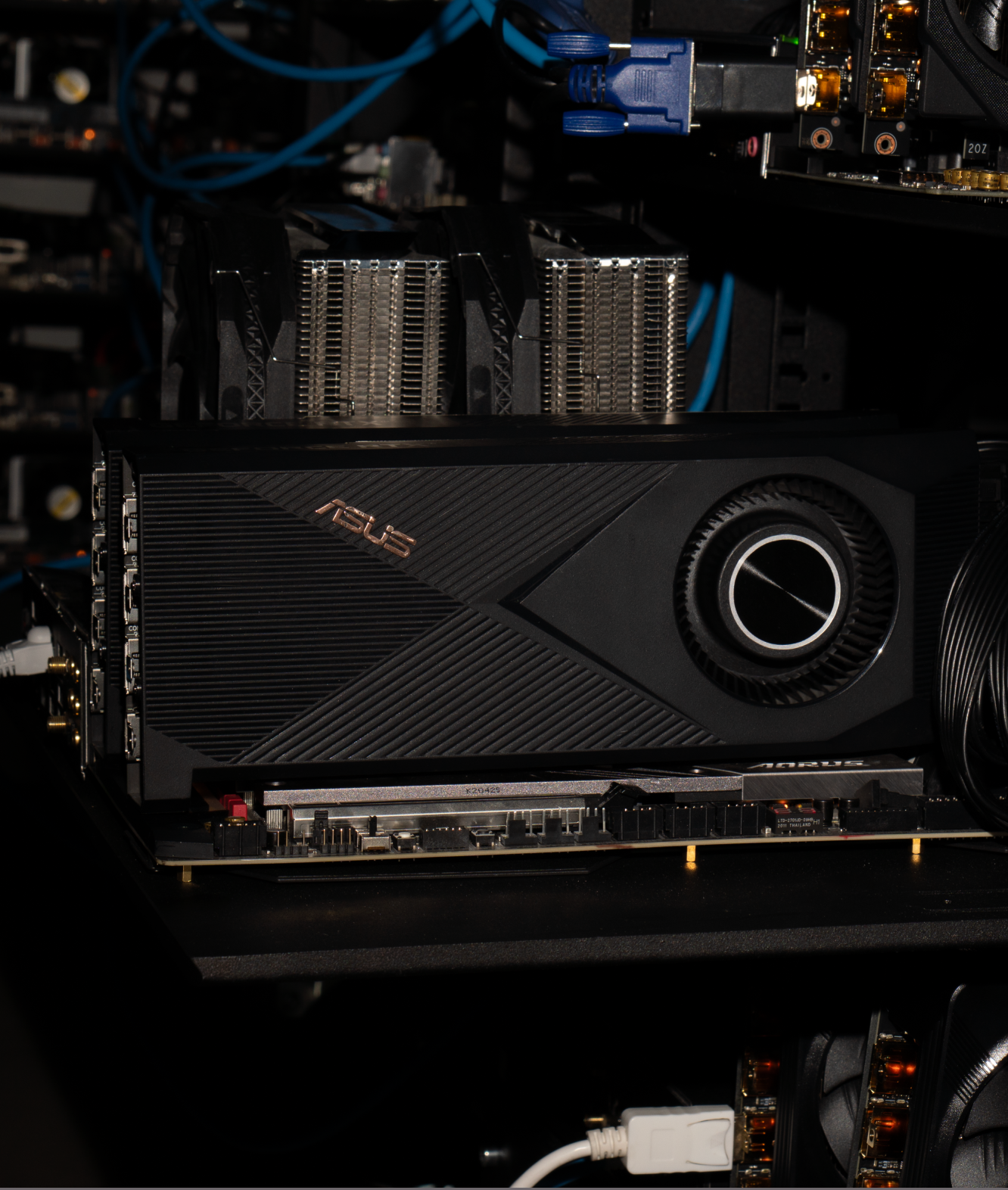

Haute performance RTX 4070 Ti SUPER & NVIDIA GeForce RTX 5080 Ti

Paiements flexibles

Processeurs multicœurs

Formation plus rapide pour les grands modèles linguistiques (LLM)

2x NVIDIA GeForce RTX 4070 Ti SUPER  OS : Ubuntu 22.04 + LLM

OS : Ubuntu 22.04 + LLM

94.5€

2x NVIDIA GeForce RTX 4070 Ti SUPER  OS : Ubuntu 22.04 + LLM

OS : Ubuntu 22.04 + LLM

94.5€

2x NVIDIA GeForce RTX 5080 Ti  OS : Ubuntu 22.04 + LLM

OS : Ubuntu 22.04 + LLM

134.50€

1x NVIDIA GeForce RTX 4070 TI SUPER  OS : Ubuntu 22.04 + LLM

OS : Ubuntu 22.04 + LLM

300.00€

2x ASUS Turbo GeForce RTX 3090  OS : Ubuntu 22.04 + LLM

OS : Ubuntu 22.04 + LLM

94.50€

Conçu pour l'IA et les charges de travail intensives en calcul

Formation à l'IA

Avec des milliers de cœurs de traitement, le GPU alimenté par le dual 4070 Ti et le GeForce RTX 5080 Ti effectue des opérations matricielles et des calculs en parallèle. Cela permet d'accélérer considérablement les tâches d'entraînement à l'IA par rapport aux CPU traditionnels.

Apprentissage profond

Les GPU gèrent efficacement les exigences de calcul intenses des réseaux neuronaux profonds et des réseaux neuronaux récurrents, qui sont essentiels pour développer des modèles d'apprentissage profond sophistiqués, y compris l'IA générative.

Calcul à haute performance

Les performances supérieures du GPU, en particulier avec la mémoire GDDR6X de 16 Go et les 7 680 cœurs CUDA de la GeForce 4070 Ti et des GeForce RTX 5080 Ticores, sont idéales pour les charges de travail intensives, y compris les algorithmes de programmation dynamique, le rendu vidéo et les simulations scientifiques.

Analyse des données

Les GPU offrent une bande passante mémoire élevée et des capacités de transfert de données efficaces, améliorant le traitement et la manipulation de grands ensembles de données pour une analyse plus rapide. Les GPU 4070 Ti et GeForce RTX 5080 Ti, avec leur vitesse de mémoire de 21 Gbps et leur architecture avancée, réduisent les goulots d'étranglement des données et accélèrent les charges de travail.

Choisissez votre configuration : IA, interface utilisateur et accès à distance

-

Oobabooga Text Gen UI

-

PyTorch (CUDA 12.4 + cuDNN)

-

SD Webui A1111

-

VM Ubuntu 22.04

En outre : A la demande, nous pouvons installer n'importe quel système d'exploitation

En outre : A la demande, nous pouvons installer n'importe quel système d'exploitation

Spécifications

Performance relative

Largeur de bande de la mémoire

Hébergement de serveurs LLM : Alimentez vos charges de travail d'IA avec AlexHost

Alors que les grands modèles de langage (LLM) deviennent de plus en plus essentiels pour le développement de l'intelligence artificielle, la demande d'hébergement de serveurs LLM continue de croître. Que vous déployiez des modèles de traitement du langage naturel, que vous entraîniez des systèmes complexes d'apprentissage automatique ou que vous exécutiez des inférences à grande échelle, le choix d'une solution d'hébergement fiable alimentée par le GPU est vital. AlexHost, un nom de confiance dans l'infrastructure de haute performance, offre des serveurs de pointe optimisés pour les LLM - combinant la performance, l'abordabilité et la confidentialité.

Hébergement LLM avec AlexHost : Conçu pour Vitesse, Construit pour Echelle

Lorsqu'il s'agit d'hébergement LLM, tous les serveurs ne sont pas créés égaux. Vous avez besoin d'un fournisseur d'hébergement qui offre une infrastructure stable, des connexions à large bande passante et une puissance GPU adaptée aux charges de travail d'IA. AlexHost fournit des solutions spécialisées conçues spécifiquement pour les scientifiques de données, les startups d'IA et les clients d'entreprise travaillant avec des LLM.

En mettant l'accent sur les serveurs bare metal GPU.

AlexHost permet aux entreprises d'accélérer la formation des modèles, de réduire la latence de l'inférence et de garder les coûts opérationnels sous contrôle. Chaque déploiement LLM hébergé par AlexHost bénéficie d'un accès racine complet, d'une protection DDoS et d'un matériel de niveau entreprise - le tout à partir d'un centre de données privacy-focused conforme au GDPR et situé en Moldavie.

Pourquoi choisir AlexHost pour un serveur d'hébergement GPU avec capacités LLM ?

Si vous travaillez sur des modèles basés sur des transformateurs, des systèmes d'IA générative ou des moteurs de chatbot en temps réel, vous aurez besoin d'un serveur d'hébergement GPU robuste avec des capacités LLM. AlexHost offre ces fonctionnalités. Elles garantissent que vos charges de travail d'IA restent rapides, sécurisées et toujours disponibles - que vous soyez en phase de recherche, de développement ou de production.

Hébergement avec GPU pour LLM L'avantage AlexHost

Choisir un hébergement avec GPU pour LLM n'est pas seulement une question de spécifications - c'est aussi une question de service, de temps de disponibilité et de contrôle. AlexHost fournit un hébergement privacy-focused libre de restrictions DMCA, vous donnant une liberté totale d'innover. Que vous formiez un LLM open-source ou que vous hébergiez un assistant d'IA privé, vous pouvez le faire en toute confiance et avec un contrôle total.

Vous cherchez un serveur GPU bon marché pour des projets LLM ?

L'une des offres les plus remarquables d'AlexHost est le serveur GPU bon marché pour le déploiement du LLM.

Une solution parfaite pour les développeurs, les chercheurs et les passionnés d'IA qui ont besoin de puissance GPU sans se ruiner. Ces plans sont conçus pour être abordables et performants, ce qui les rend idéaux pour l'entraînement de modèles légers, l'exécution de LLM affinés ou le service de points finaux d'inférence en temps réel.

Tous les plans d'hébergement sont ignorés par le DMCA :

- Ressources GPU dédiéesEnvironnement totalement isolé

- Allocations de mémoire vive élevéesAdapté aux tâches d'apprentissage en profondeur

- Stockage SSD NVMepour un accès rapide aux données et une sauvegarde des points de contrôle

- Accès complet à la racineEt personnalisation au niveau du système d'exploitation Protection DDoS et hébergement des données à l'étranger pour une plus grande confidentialité

- Protection DDoSHébergement de données à l'étranger pour une meilleure protection de la vie privée

Contrairement à de nombreux fournisseurs de services en nuage qui proposent un accès partagé ou limité au GPU à des tarifs élevés

AlexHost fournit une infrastructure rentable adaptée aux flux de travail de l'IA. Que vous développiez avec PyTorch, TensorFlow, ou que vous exécutiez des frameworks populaires comme Hugging Face Transformers, ces environnements de serveurs sont optimisés pour le déploiement LLM dès le premier jour.

En outre

AlexHost propose des cycles de facturation flexibles, vous permettant de payer mensuellement ou à l'heure, de sorte que vous ne dépensez que lorsque vous avez réellement besoin de temps de calcul. Ceci est particulièrement utile pour les startups qui travaillent avec des budgets limités ou pour les développeurs qui ont besoin de créer des environnements de formation temporaires à la demande.

Que vous entraîniez des modèles, hébergiez des points de terminaison d’inférence ou construisiez des applications alimentées par l’IA, AlexHost vous permet d’en faire plus – plus rapidement, de manière plus sûre et à un prix plus abordable Notre équipe d’assistance est disponible 24/7 pour vous aider à configurer l’environnement parfait pour votre projet LLM, adapté à vos exigences exactes en matière de ressources et de budget.